… mentre finivo di scrivere il corso

Il 24 marzo 2026, verso le diciassette italiane, OpenAI ha annunciato la chiusura di Sora. Io avevo appena finito di scrivere il piano di tre lezioni su video e intelligenza artificiale per edu3d. Nel piano, Sora non compariva — l’avevo esclusa settimane prima, per ragioni pratiche: accesso complicato, target scolastico, non aveva senso.

Ho riletto l’annuncio e ho provato una cosa strana. Non soddisfazione, non malinconia. Qualcosa di più preciso: la conferma che il corso era stato progettato nel modo sbagliato, ma per le ragioni giuste.

Dal 2011 al 2018, nelle aule di formazione docenti, ogni strumento nuovo — LIM, Second Life, poi i primissimi chatbot — portava con sé la stessa domanda, nei primi dieci minuti. Non “come funziona?” né “a cosa serve?”. La domanda era: “durerà?”. I docenti avevano visto troppi strumenti arrivare con fanfara istituzionale e scomparire nell’arco di un contratto ministeriale. Avevano imparato — per esperienza, non per cinismo — a non investire nella cosa, ma nel metodo. In un certo senso somigliavano ai contadini del Neorealismo: gente che ha visto troppe riforme calare dall’alto per fidarsi della prossima, e che nel frattempo ha continuato a lavorare la terra con quello che aveva. In La terra trema di Visconti i pescatori di Aci Trezza perdono tutto provando a fare da soli contro il sistema dei grossisti — ma il sistema che li schiaccia è lo stesso che gli ha insegnato a pescare. I docenti italiani conoscono quella scena dall’interno: lo strumento che il ministero ti dà è lo stesso che il ministero ti toglie.

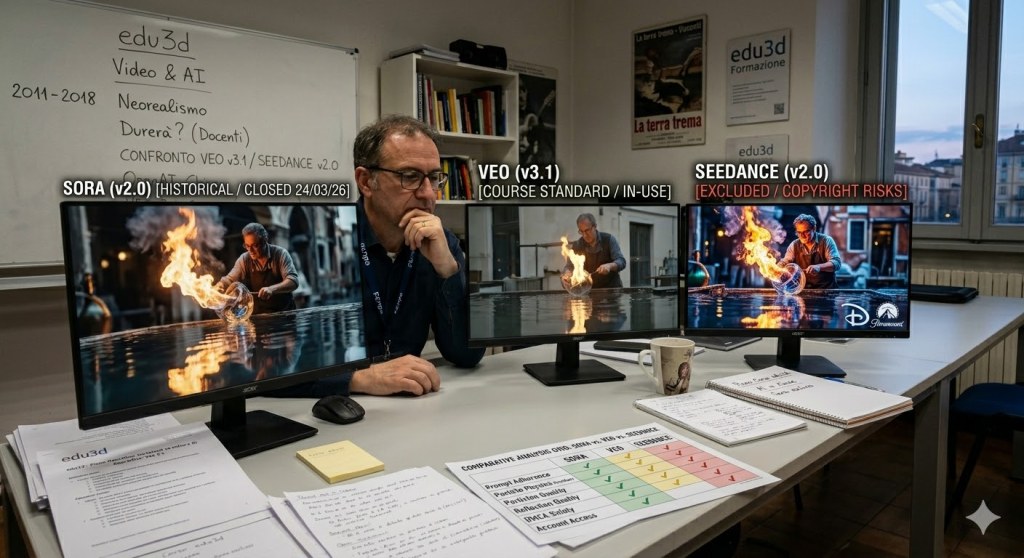

Sora ha fatto un milione di download in cinque giorni a settembre 2025. Sei mesi dopo non esiste più. Il corso che stavo scrivendo prevedeva, come esercizio centrale della seconda lezione, il confronto tra due modelli sullo stesso prompt. Avevo scelto Veo 3.1 e Seedance 2.0. Sora era già fuori. Grok/xAI lo ho escluso per un motivo diverso: non tecnico, ma di igiene istituzionale. Portare in classe uno strumento associato a Musk nel 2026 significa aprire una discussione che non è quella del corso. Un docente non può difenderlo a un consiglio di classe — e se non puoi difenderlo, non puoi usarlo.

Quindi: Sora fuori perché instabile, Grok fuori perché politicamente rumoroso, Seedance fuori per le diffide di Disney e Paramount e per l’accesso che presupponeva un account cinese. Restava Google con Veo 3.1. Solo Google. L’unico grande operatore con account già presenti nelle scuole, con una postura GDPR difendibile, con SynthID come risposta (parziale, ma esistente) alla questione del watermarking — e con un interesse strutturale nel mondo scolastico che nessuno in aula ha mai messo a verbale.

Questo mi ha fatto sentire in colpa per qualche ora. Come se avessi costruito il corso intorno all’unico strumento disponibile invece che intorno ai migliori strumenti. Come se stessi insegnando ai partecipanti a usare ciò che il mercato lascia sul tavolo.

Vabbè. Era l’unico rimasto sul tavolo, e il tavolo non l’ho apparecchiato io.

Poi ho riletto il piano. E mi sono accorto che il corso non insegnava Veo. Insegnava tre cose che non dipendono da nessun modello: pensare all’inquadratura prima di scrivere il prompt, valutare criticamente dove il risultato si rompe, scegliere lo strumento in base al contesto, non alla reputazione. La terza è quella che conta. Il contesto scolastico non è il contesto di un regista indipendente o di uno studio di produzione. Ha vincoli diversi — legali, relazionali, istituzionali — e pretendere di ignorarli in nome della libertà tecnologica è una forma di ingenuità che ha bruciato troppi progetti didattici.

Il corso aveva scritto, come nota di rischio nella sezione logistica: “verificare disponibilità al momento — il panorama degli accessi cambia”. L’avevo scritto pensando a possibili aggiornamenti di accesso o piani tariffari. Non pensavo che uno strumento sarebbe scomparso nel giro di una settimana dalla lezione.

Fra sei mesi i modelli saranno altri. Qualcuno dei partecipanti userà Runway, qualcuno Kling, qualcuno uno strumento che non esiste ancora. La competenza utile non è sapere come funziona Veo 3.1 — è saper fare la stessa domanda a qualsiasi modello nuovo: dove si rompe? cosa non riesce a fare? in quale contesto posso fidarmi di questo output?

Saper vedere i difetti è la competenza che resta oggi. Ma c’è un limite incorporato in questa formulazione: quando i modelli smetteranno di produrre errori evidenti in superficie — mani a sei dita, fisica degli oggetti impossibile, labiale fuori sincrono — dove si sposterà il punto di ancoraggio? La rottura futura non sarà visiva, sarà semantica: cosa il modello ha deciso senza che tu glielo chiedessi? Qual è il suo default non dichiarato su una famiglia, su un volto, su un interno domestico? Non “dove si rompe?” ma “cosa ha scelto senza che tu lo sapessi?”.

Il piano delle tre lezioni è in appendice. Veo 3.1, solo Google. Con tutto quello che comporta.

Riferimenti

[1] CNBC, OpenAI shutters short-form video app Sora as company reels in costs, 24 marzo 2026. https://www.cnbc.com/2026/03/24/openai-shutters-short-form-video-app-sora-as-company-reels-in-costs.html

[2] Variety, OpenAI Will Shut Down Sora Video Platform; Disney Drops Plans for $1 Billion Investment, 24 marzo 2026. https://variety.com/2026/digital/news/openai-shutting-down-sora-video-disney-1236698277/

[3] Bloomberg, OpenAI Discontinues Sora App, Shuts Down Video Generation Service and API, 24 marzo 2026. https://www.bloomberg.com/news/articles/2026-03-24/openai-plans-to-discontinue-support-for-sora-ai-video-generator

Appendice — Piano operativo: tre lezioni su video e AI

edu3d, mercoledì sera su Zoom — 29 aprile, 6 maggio, 13 maggio 2026. Pubblico: partecipanti edu3d, livelli misti. Strumento unico: Veo 3.1 via Gemini app.

Prima del 29 aprile, tutti i partecipanti devono avere un account Google funzionante per accedere a Veo 3.1 tramite Gemini app — è il punto d’ingresso più semplice, senza account cinesi né partner program. Serve anche DaVinci Resolve installato (gratuito) oppure CapCut desktop come alternativa. Chi vuole lavorare sull’audio, un account ElevenLabs free basta.

Il panorama degli strumenti, a fine marzo 2026, è un campo minato. Seedance 2.0 è fuori per le diffide di Disney e Paramount e perché richiede un account Douyin. Grok/xAI è fuori per ragioni istituzionali — non è difendibile in un consiglio di classe nel 2026. Sora è stata chiusa da OpenAI il 24 marzo. Resta Veo 3.1. Solo Veo 3.1.

Il principio guida del corso è uno: la grammatica si impara facendo, non prima di fare. Si genera dal minuto quindici.

Lezione 1 — 29 aprile: genera, guarda, capisci perché non funziona

I primi quindici minuti servono a orientarsi. I modelli di generazione video prendono testo o immagine e producono video — il modello ha visto milioni di ore di filmati e ne ha estratto pattern. Fine, niente architetture. Una cronologia lampo dà la scala del salto: marzo 2023, Will Smith mangia spaghetti (un incubo); maggio 2025, The Colorless Man (sei tool, seicento dollari, due settimane di lavoro); febbraio 2026, Time Traveler (un tool, duecento dollari, un giorno). Trenta secondi per ciascuno dei tre video. Il salto si vede senza commentarlo.

Il cuore della lezione è il primo esercizio, quaranta minuti. Vincolo: una persona che fa un’azione in un luogo. Niente astratto, niente paesaggi — serve un soggetto con un corpo che si muove. Il prompt sta in due righe, massimo. Si genera, si guarda, e poi si scrivono tre cose che non funzionano: mani, continuità, fisica degli oggetti, labiale, tagli insensati. Non “quanto è figo” — dove si rompe. Saper vedere i difetti è la competenza che resta oggi, finché i difetti restano visibili in superficie.

Gli ultimi venticinque minuti spostano l’attenzione sul prompt come atto di regia. Come cambia il risultato se scrivi “piano sequenza” invece di “campo/controcampo” o “primo piano”? Stessa scena, tre prompt con inquadrature diverse. Il modello capisce — più o meno — il linguaggio cinematografico. Se non lo conosci, non puoi chiedergli niente di preciso. Il mini-glossario da tenere sotto mano copre l’essenziale: piano sequenza, campo/controcampo, primo piano, carrellata, panoramica, taglio.

Come esercizio a casa, chi vuole genera tre clip da cinque secondi ciascuna con tre inquadrature diverse sullo stesso soggetto. Porta i risultati la settimana dopo.

Materiale da preparare: la clip di Will Smith 2023, quella di Time Traveler di Al-Ghaili, quella di The Colorless Man, il mini-glossario inquadrature in PDF, e la verifica degli accessi Veo 3.1 per tutti i partecipanti.

Lezione 2 — 6 maggio: stesso soggetto, stesso prompt, strumento unico

Questa lezione era progettata come confronto tra due modelli. Con Seedance fuori, la struttura si adatta: si confrontano varianti di prompt sullo stesso modello, e il docente mostra clip pre-generate su Seedance come documento storico — non come strumento attivo.

I primi trenta minuti sono un confronto guidato. Si sceglie insieme un soggetto unico per tutta la classe — per esempio: un uomo anziano apre una porta e scopre qualcosa di inaspettato. Si generano tre varianti dello stesso prompt con inquadrature diverse su Veo 3.1. Il docente mostra anche due clip pre-generate su Seedance 2.0 per dare un termine di paragone: stessa scena, modello diverso, restrizioni diverse. Seedance non è disponibile in aula — è un documento, non uno strumento. Per ogni clip, una griglia di osservazione: qualità visiva, coerenza del personaggio, fisica degli oggetti, audio e labiale, aderenza al prompt, restrizioni incontrate, tempo di generazione. La discussione che ne esce è la parte che conta: cosa cambia quando cambi inquadratura? Cosa il modello fraintende sistematicamente? Dove il prompt è ambiguo e il modello decide da solo?

Quindici minuti sulla questione copyright — tre fatti, non opinioni. Seedance 2.0 è sotto diffida di Disney, Paramount, Netflix: addestrato su materiale protetto senza licenza. Veo 3.1 ha SynthID e filtri di sicurezza — Google si posiziona come “safe”, ma il corpus di addestramento non è completamente trasparente neanche qui. Per un progetto personale la differenza è irrilevante. Per un progetto scolastico con studenti minorenni, è la prima domanda da farsi. Regola pratica: se il video esce con il logo di qualcun altro, con un personaggio riconoscibile, o con uno stile troppo specifico di un regista noto — è un problema.

Trentacinque minuti di lavoro pratico. Ogni partecipante sceglie un soggetto e genera tre clip con tre prompt diversi — obiettivo: produrre tre clip da otto-dieci secondi e compilare la griglia. Il fuoco non è “quale è più bello” ma “quale prompt mi dà più controllo”. Quando il modello genera un taglio che non volevi, come reagisci? Riscrivi? Rigeneri? Accetti? Il corsista deve iniziare a sviluppare un giudizio su quando il risultato è abbastanza buono e quando va rifatto.

Negli ultimi dieci minuti, il brief per il progetto finale: un corto di trenta secondi, tema libero. Struttura obbligatoria: almeno tre inquadrature diverse, almeno un cambio di scena o di tempo, audio generato o aggiunto dopo. Chi vuole prepara uno storyboard di quattro-sei frame — anche schizzi a mano, foto dal telefono.

Materiale da preparare: il prompt unico testato in anticipo, le clip pre-generate su Seedance come documento comparativo, un Google Sheet condiviso per la griglia, tre slide sulla questione copyright.

Lezione 3 — 13 maggio: fai il tuo corto, rompi almeno una cosa

Cinquanta minuti di produzione assistita. Ogni partecipante lavora al proprio corto di trenta secondi. Il flusso: soggetto, storyboard (cinque minuti se non l’ha fatto a casa), prompt per ogni scena scritto prima di generare, generazione, valutazione, rigenerazione. C’è una regola obbligatoria: rigenerare almeno una clip e spiegare in una frase perché quella precedente non andava bene. “Il personaggio cambiava faccia”, “il taglio spezzava il ritmo”, “le mani facevano cose impossibili” — va bene tutto purché sia specifico. Poi montaggio in DaVinci Resolve o CapCut, audio se manca, export MP4.

Venti minuti di proiezione. Ogni partecipante mostra il proprio corto. Per ciascuno: cosa ha funzionato meglio (risponde il partecipante), qual è stata la rigenerazione obbligatoria e perché, feedback del gruppo in giro rapido — una cosa che funziona, una che miglioreresti.

La chiusura, altri venti minuti, sposta la domanda in avanti. I difetti visivi attuali — mani a sei dita, fisica impossibile, labiale fuori sincrono — sono riconoscibili perché i modelli li producono ancora. Quando smetteranno di produrli, il punto di ancoraggio critico dovrà essere altrove. Esercizio dimostrativo: stesso prompt “una famiglia a cena”, scritto senza specificare nulla. Poi con “una famiglia italiana a cena negli anni ’70”. Poi “una famiglia a cena, contesto non specificato, regione subsahariana”. Si guarda cosa il modello genera di default: quante persone, che età, che interni, che luce, che cibo. Non cerchi il pixel sbagliato — cerchi il default non dichiarato. Cosa ha deciso senza che tu glielo chiedessi?

La domanda guida non è più “dove si rompe?” ma “cosa ha scelto al posto tuo?”. Questa è la competenza che resterà utile quando i modelli diventeranno formalmente perfetti.

Invito finale: condividere i corti sul canale Discord o sul gruppo edu3d. Quando esce un modello nuovo, provare lo stesso esercizio “famiglia a cena” e confrontare i default. I default cambiano più lentamente degli output — e sono più rivelatori.

Materiale da preparare: template storyboard a sei riquadri, breakout rooms Zoom preconfigurate se i partecipanti sono più di dieci, timer visibile per la fase di produzione, cartella condivisa per l’upload dei corti finali, tre clip “famiglia a cena” pre-generate con i tre prompt per la dimostrazione finale.

Cosa può andare storto. Veo 3.1 via Gemini app potrebbe avere limiti di generazione gratuita — verificare quanti clip si possono generare per account free prima del corso. I tempi di generazione sono il rischio principale: se il modello impiega tre minuti per clip, in live non puoi aspettare — le clip pre-generate di backup non sono un piano B, sono il piano A con variante live. Verificare anche che DaVinci Resolve giri su macchine Windows medie, perché RAM e GPU non sono mai scontate.

Leave a comment