Ovvero: come ho smesso di vedere sei dita e ho iniziato a preoccuparmi

Cinque anni fa passavo le sere su Colab, a guardare immagini che emergevano da macchie di rumore come fantasmi da una nebbia digitale. Ogni generazione era un’attesa: minuti, a volte quarti d’ora, per vedere se il volto avrebbe avuto due occhi o tre, se le mani sarebbero state mani o artigli di gambero. Era magia lenta, e l’errore era sempre visibile. Oggi genero la stessa immagine in quattro secondi, sul mio portatile, e l’errore non lo vedo più.

Non perché sia sparito. Perché si è raffinato.

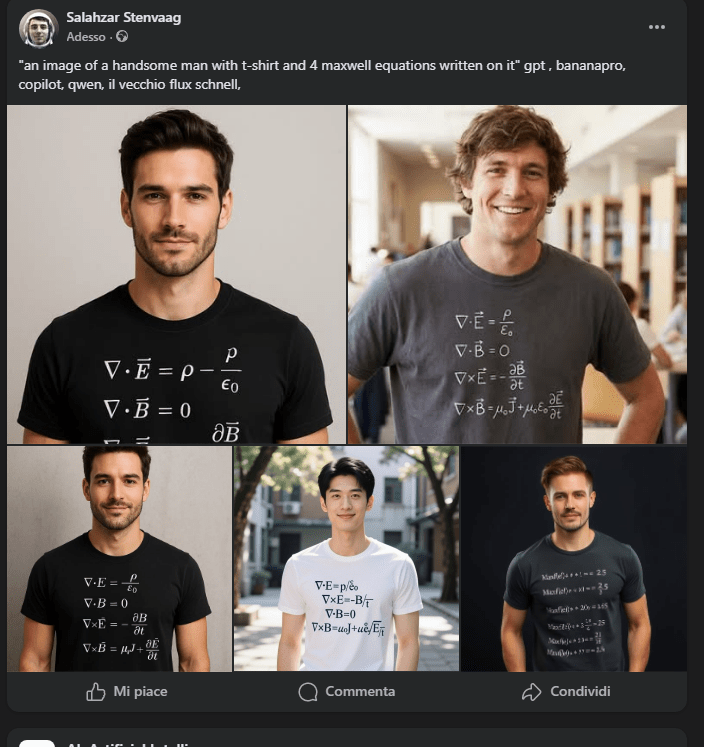

Ho messo in fila cinque modelli — ChatGPT, Copilot, Qwen, Flux — e ho chiesto la stessa cosa: un uomo attraente con una maglietta su cui sono stampate le equazioni di Maxwell. Una prova semplice, quasi banale. I risultati raccontano una storia che non è di progresso lineare, ma di traslazione del problema.

I primi due — ChatGPT e Copilot — producono immagini sorprendentemente solide. Volti credibili, pose naturali, stampa leggibile. Le equazioni sono quasi tutte corrette, con errori minimi o omissioni. L’allucinazione qui è timida: il modello sa cosa sta rappresentando, ma non sempre perché. Competenza formale senza comprensione semantica. Come un copista medievale che riproduce un testo greco senza conoscere il greco.

Qwen è più interessante. Ha le idee giuste ma esita. Le formule sono concettualmente orientate nel verso corretto, però i simboli sbagliano, i termini si troncano, i segni non tornano. Non inventa a caso — non chiude il cerchio. È l’errore di chi sa l’argomento ma va in crisi all’esame. Allucinazione per incompletezza.

Poi c’è Flux. Flux è realismo allucinatorio. Scrive cose che assomigliano a equazioni ma non appartengono a nessun dominio coerente. Non è ignoranza: è sovradattamento estetico. Il modello ha imparato che “se sembra matematica, va bene”.

C’è una ragione tecnica. Questi sistemi vengono addestrati per produrre immagini convincenti, non contenuti corretti. La funzione di perdita — il metro con cui il modello misura i propri errori — è percettiva, non semantica. Se l’equazione è sbagliata ma la foto sembra vera, il modello non viene punito. E così impara esattamente quello che gli insegniamo: a essere persuasivo, non veritiero. L’AI sta hackerando il nostro sistema di fiducia visiva, che evolutivamente non è programmato per dubitare di oggetti fisicamente coerenti.

Umberto Eco, nel 1964, divideva il mondo in apocalittici e integrati. I primi rifiutavano la cultura di massa in blocco — televisione, fumetti, pubblicità — come corruzione dello spirito. I secondi l’abbracciavano senza filtro, celebrandone la democratizzazione. Eco mostrava che entrambe le posizioni erano pigre: l’apocalittico non guarda davvero, condanna a priori; l’integrato nemmeno, celebra a priori.

Sessant’anni dopo, siamo nella stessa trappola con l’intelligenza artificiale. Gli apocalittici vedono solo l’inganno, il falso, la manipolazione. Gli integrati vedono solo il progresso, l’efficienza, il futuro. Ma il punto non è se l’AI sia buona o cattiva. Il punto è che il segno è cambiato, e bisogna aggiornare la lettura.

Eco distingueva tra uso e interpretazione dei testi. Un testo può essere usato — strumentalmente, per confermare quello che già pensi — o interpretato — criticamente, cercando cosa dice davvero. Le immagini generate si usano, raramente si interpretano. Chi guarda le equazioni di Maxwell sulla maglietta non le legge: le riconosce come schema. È uso, non interpretazione. Ed è esattamente lì che l’allucinazione si nasconde.

C’è un parallelo che mi torna in mente spesso. I falsi d’autore in pittura.

I falsi più pericolosi non sono quelli tecnicamente imperfetti — quelli li sgami subito, basta un occhio allenato. Sono quelli che capiscono lo stile ma tradiscono l’intenzione. Beltracchi non sbagliava i colori. Sbagliava il perché di certe scelte. E per vederlo serviva uno storico dell’arte, non un restauratore.

I modelli visivi oggi sono Beltracchi. Non sbagliano più le dita. Sbagliano il significato. E per accorgersene non basta l’occhio: serve il contesto disciplinare. Serve sapere cosa dicono davvero le equazioni di Maxwell per capire che quella maglietta mente.

Siamo passati da immagini sbagliate in modo evidente a immagini plausibili ma potenzialmente ingannevoli. È un cambio di regime cognitivo. Prima vedevi che era falso. Ora devi capirlo per accorgertene.

E qui si apre il problema vero. Quello che non si risolve con modelli migliori.

La verifica diventa un privilegio epistemico. Se per smascherare l’errore devi già conoscere Maxwell, allora l’AI è affidabile esattamente per chi non ne ha bisogno, e inaffidabile per chi ci si affida davvero. Lo studente che cerca un’immagine per la tesina non ha gli strumenti per verificare. Il fisico non ha bisogno dell’immagine.

Ma c’è un secondo livello, più subdolo. Non è solo questione di sapere: è questione di tempo. La verifica costa — in minuti, in attenzione, in fatica cognitiva. L’automazione promette velocità; se per usarla devo fermarmi a controllare ogni formula, il vantaggio scompare. Per pura logica economica, la massa accetterà l’allucinazione raffinata come “abbastanza buona”, mentre chi può permettersi il lusso del dubbio — studierà, pagherà, o semplicemente rallenterà — avrà accesso alla verità. Il privilegio epistemico diventa privilegio di classe.

E nelle scuole? Nelle scuole italiane, intendo. Quelle con i computer da trecento euro, senza scheda grafica, senza la possibilità di far girare nemmeno un modello locale per capire come funziona. Quelle dove l’AI è qualcosa che succede altrove, su server lontani, e arriva già confezionata, già plausibile, già impossibile da smontare.

Il divario digitale non si chiude. Si stratifica. Non è più “chi ha internet e chi no”. È “chi può verificare e chi deve fidarsi”. E fidarsi di un sistema che sbaglia in modo intelligente è molto più pericoloso che fidarsi di uno che sbaglia in modo stupido.

La direzione è chiara, e in un certo senso è un buon segno. Meno allucinazioni percettive, più allucinazioni concettuali. Il progresso non elimina il problema: lo sposta su un piano più alto. Significa che il limite non è più l’occhio, ma il significato.

Cinque anni fa guardavo macchie diventare immagini e mi sembrava di assistere a una nascita. Oggi guardo immagini perfette e mi chiedo cosa nascondano. Il salto non è solo tecnico. È epistemologico.

Eco aveva ragione: né apocalittici né integrati. Ma la terza via — quella del semiologo, quella di chi guarda il segno e si chiede cosa significhi davvero — richiede strumenti che non si distribuiscono con i fondi PNRR. Richiede tempo, formazione, pensiero critico. Richiede, in ultima analisi, che qualcuno insegni a leggere. Non le lettere. Gli schemi.

E su questo, come su molte cose, siamo ancora fermi alle macchie.

Riferimenti

- Eco, U. (1964). Apocalittici e integrati. Bompiani. — L’impianto teorico sulla ricezione critica vs acritica della cultura di massa resta sorprendentemente applicabile ai media generativi.

- Frankfurt, H. (2005). On Bullshit. Princeton University Press. — La distinzione tra menzogna (che presuppone conoscenza del vero) e bullshit (indifferenza alla verità) illumina il comportamento dei modelli che producono “matematica plausibile” senza comprensione.

- Birkenstock, A. (2014). Beltracchi: Die Kunst der Fälschung [documentario]. — Il caso Beltracchi come esempio paradigmatico di falsificazione che tradisce l’intenzione, non la tecnica.

- Baudrillard, J. (1981). Simulacres et Simulation. Galilée. — La maglietta di Flux è terza fase del simulacro: maschera l’assenza di realtà profonda. Non mente sulle equazioni — finge che ci siano equazioni da mentire.

Leave a comment